Tracking de las manos en Quest

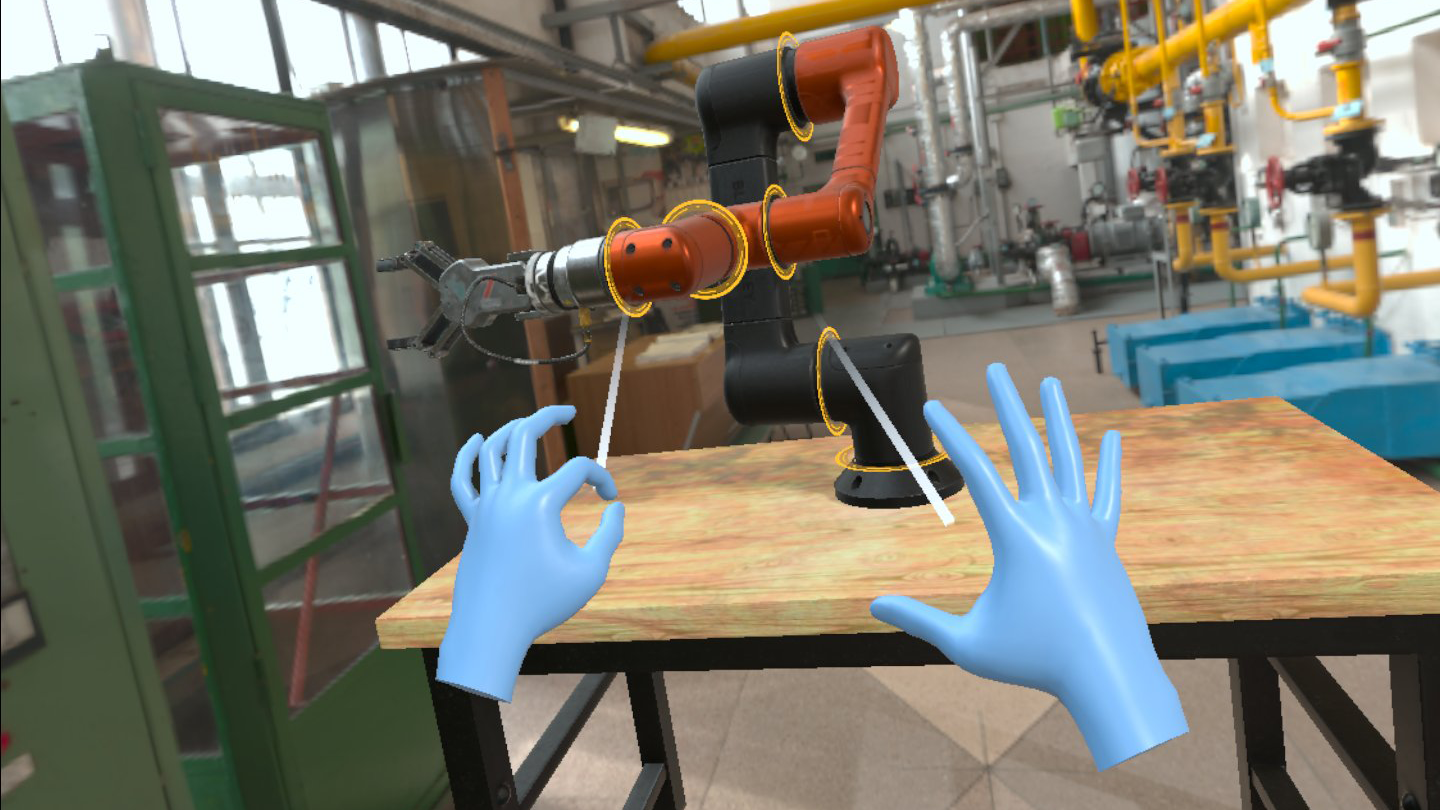

En esta versión de Evergine, la integración de OpenXR tiene ahora la capacidad de Hand Tracking. El Hand Tracking en las aplicaciones XR permite a los usuarios interactuar con objetos y entornos virtuales utilizando sus manos. Esta es una nueva forma de interactuar con tu escena virtual sin necesidad de los típicos controladores de mano.

Los dispositivos Meta Quest son los que más se beneficiarán de esta función.

Articulaciones de la mano con soporte

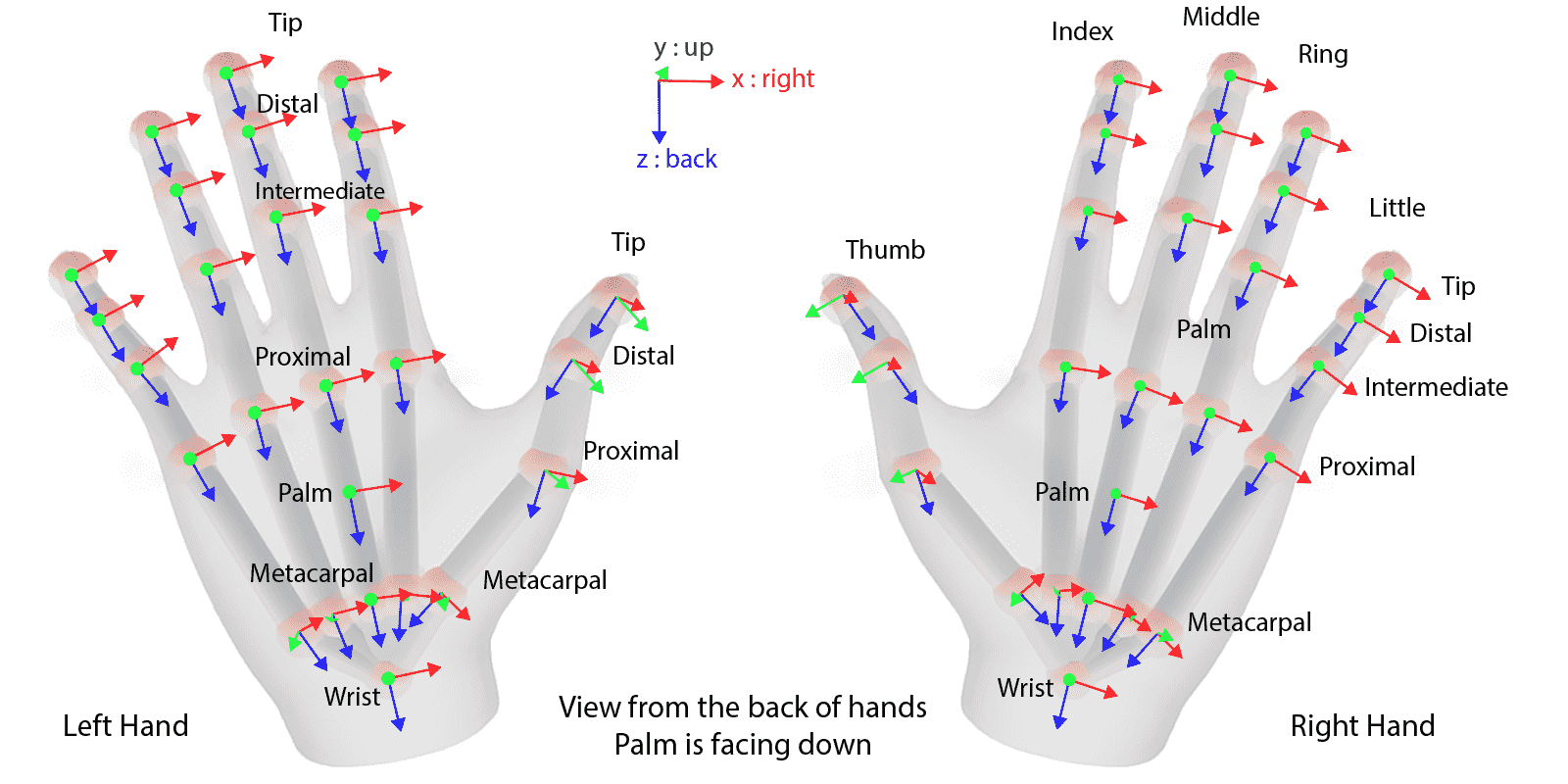

Evergine proporciona una lista actualizada de los joints de la mano. Define 26 articulaciones para el seguimiento de la mano: 4 joints para el dedo pulgar, 5 joints para los otros cuatro dedos y las joints de la muñeca y la palma:

Renderizar manos

El uso del nuevo componente XRDeviceRenderableModel añade la posibilidad de obtener un modelo renderizable asociado a un controlador XR. En el caso de las manos articuladas, proporciona una malla sin piel de la mano que sigue las poses de la mano del usuario:

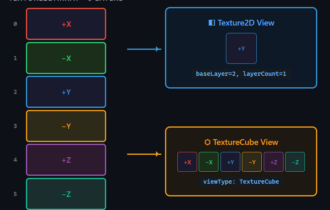

Nuevas extensiones soportadas por OpenXR

Las siguientes extensiones de OpenXR han sido reemplazadas para proporcionar el tracking de la mano:

- XR_EXT_hand_tracking: Extensión estándar que ofrece la pose de la malla de la mano.

- XR_FB_hand_tracking_aim: Extensión propietaria de Meta, que aporta una capa de reconocimiento de gestos.

- XR_FB_hand_tracking_mesh: Extensión propietaria de Meta, que proporciona un modelo de piel para renderizar las manos en los dispositivos Quest.